Manchmal werden Sie selbst als Tech-Reporter überrascht sein, wie schnell sich die Technologie weiterentwickelt. Ein typisches Beispiel: Ich habe erst heute erfahren, dass mein iPhone eine Funktion bietet, die ich mir schon lange gewünscht habe – die Möglichkeit, Pflanzen und Blumen nur aus einem Foto auszuwählen.

Es stimmt, dass viele Apps von Drittanbietern diese Funktionalität seit Jahren anbieten, aber als ich sie das letzte Mal ausprobierte, war ich von ihrer Geschwindigkeit und Genauigkeit enttäuscht. Und ja, es gibt Google Lens und Snapchat-Scanaber es ist nicht immer bequem, eine App zu öffnen, die ich sonst nicht verwenden würde.

Aber seit der Einführung von iOS 15 im vergangenen September hat Apple eine eigene Version dieser visuellen Suchfunktion eingeführt. es heißt visuelle Suchewas sehr gut ist.

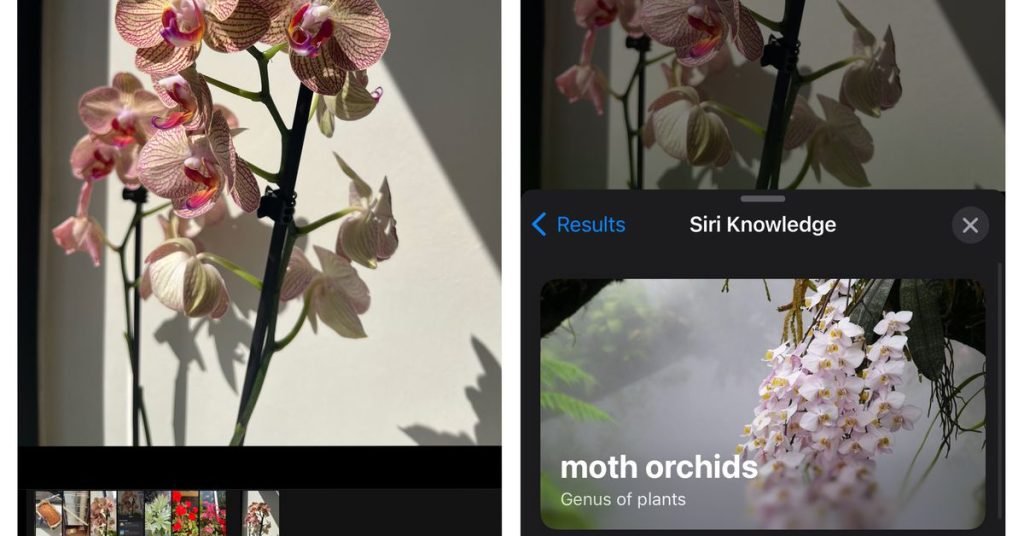

Es funktioniert einfach. Öffnen Sie einfach ein Foto oder einen Screenshot in der Fotos-App und suchen Sie nach dem blauen „i“-Symbol darunter. Wenn es einen kleinen glänzenden Ring um sich herum hat, hat iOS etwas auf dem Foto gefunden, das es mithilfe von maschinellem Lernen identifizieren kann. Klicken Sie auf das Symbol und dann auf Suchen, und es wird versucht, einige nützliche Informationen zu finden.

Es funktioniert nicht nur mit Pflanzen und Blumen, sondern auch mit Sehenswürdigkeiten, Kunstwerken, Haustieren und „anderen Dingen“. Es ist natürlich nicht perfekt, aber es hat mich öfter überrascht als enttäuscht. Hier sind nur einige Beispiele aus meiner Kamerarolle:

Obwohl Apple dieses Feature letztes Jahr auf der WWDC angekündigt hat, hat es seine genaue Verfügbarkeit nicht bekannt gegeben. (Ich habe es über einen Link in einem meiner Lieblings-Tech-Newsletter entdeckt, übertrieben.) Sogar die offizielle Visual Look Up-Supportseite bietet gemischte Nachrichten, die Ihnen an einer Stelle mitteilen, dass es sich um „nur USA“ handelt, und dann andere kompatible Regionen auflistet andere Seite.

visuelle Suche Er Es ist immer noch in seiner Verfügbarkeit begrenzt, aber der Zugriff wurde seit dem Start erweitert. Es ist jetzt in Englisch in den USA, Australien, Kanada, Großbritannien, Singapur und Indonesien verfügbar; auf Französisch in Frankreich; in Deutschland in Deutschland; auf Italienisch in Italien; Und auf Spanisch in Spanien, Mexiko und den Vereinigten Staaten.

Es ist eine nette Funktion, aber ich habe mich auch gefragt, was die visuelle Suche sonst noch leisten kann. Stellen Sie sich vor, Sie machen zum Beispiel ein Foto von Ihrer neuen Zimmerpflanze, nur um Siri fragen zu lassen: „Soll ich Erinnerungen für einen Bewässerungsplan einrichten?“ Oder, wenn Sie ein Foto von einem Lehrer im Urlaub machen, lassen Sie Siri im Internet nach Öffnungszeiten suchen und wo Sie Tickets kaufen können.

Das habe ich vor langer Zeit gelernt Es ist töricht, seine Hoffnungen auf Siri zu setzen Etwas zu fortgeschrittenes tun. Aber das sind die Arten von Funktionen, die wir möglicherweise mit zukünftigen AR- oder VR-Headsets erhalten werden. Hoffen wir, dass, wenn Apple diese Art von Funktionalität anbietet, es noch mehr Aufsehen erregt.

„Webspezialist. Lebenslanger Zombie-Experte. Kaffee-Ninja. Hipster-freundlicher Analyst.“

More Stories

Die nächste 4K-Minidrohne von DJI passt in Ihre Handfläche

Leaks enthüllen den Namen und das Design des angeblichen PS5 Pro-Geräts

Apple führt mit dem neuesten iOS-Update die KI-Objektentfernung in Fotos ein